HTTP/1.1 vs HTTP/2(多重化と直列処理の比較)

HTTP/1.1の直列処理とHTTP/2の多重化の違い。Head-of-line blockingの影響を比較する

1HTTP/1.1 vs HTTP/2 とは

HTTP/2は、HTTP/1.1の後継プロトコルで、2015年にRFC 7540として標準化されました。 Webページの読み込み速度を大幅に向上させるために設計されています。分かりやすいアナロジーで説明すると、HTTP/1.1は料金所が6つある高速道路のようなものです。 各料金所(TCP接続)では車(リクエスト)が1台ずつ順番に通過し、前の車が遅いと後ろの車も待たされます(Head-of-line blocking)。一方、HTTP/2は1本の道路に無制限の車線がある高速道路です。 1本のTCP接続の中で複数のリクエストが同時に並行して流れるため、1つの遅いリクエストが他をブロックしません。 上のビジュアライザーで「HOL blockingデモ」シナリオを選ぶと、この違いが鮮明に見えます。

2主な違い

- 🔀多重化(Multiplexing):HTTP/2の最大の特徴です。1本のTCP接続で複数のリクエスト・レスポンスを同時に処理できます。HTTP/1.1ではドメインあたり最大6本のTCP接続を開き、各接続で1つずつ直列に処理していました。多重化により接続のオーバーヘッドが大幅に削減されます。

- 📦ヘッダー圧縮(HPACK):HTTP/1.1ではヘッダーがプレーンテキストで毎回送信されていました。HTTP/2のHPAC圧縮は、ヘッダーの重複を除去し、ハフマン符号化でサイズを削減します。Cookieのような大きなヘッダーで特に効果的です。

- ⚡サーバープッシュ:サーバーがクライアントのリクエストを待たずに、必要になると予測されるリソースを先行送信できます。例えば、HTMLをリクエストされた時点で、そのHTMLが参照するCSSやJSをプッシュできます。

- 🔢ストリーム優先度:リソースに優先順位を付けられます。例えば、CSSとJSは画像より優先度を高く設定し、レンダリングブロッキングリソースを先に読み込むことで、体感速度を改善できます。

3ユースケース

4用語解説

5HTTP/1.1 vs HTTP/2 比較表

| 項目 | HTTP/1.1 | HTTP/2 |

|---|---|---|

| 接続方式 | ドメインあたり最大6本のTCP接続 | 1本のTCP接続で多重化 |

| 多重化 | 非対応(直列処理) | 対応(ストリームで並行処理) |

| ヘッダー形式 | プレーンテキスト(毎回全送信) | HPACK圧縮(差分のみ送信) |

| サーバープッシュ | 非対応 | 対応(PUSH_PROMISE) |

| 優先度制御 | 非対応 | 対応(ストリーム優先度) |

| プロトコル | テキストベース | バイナリフレーム |

6通信の手順比較

7Head-of-line blocking の詳細

Head-of-line(HOL)blockingは、先頭のリクエスト/レスポンスが遅い場合に、後続のリクエストがブロックされる問題です。 これはHTTPの各バージョンで異なるレベルで発生します。

8移行ガイド

listen 443 ssl http2;Protocols h2 h2c http/1.1/* デフォルトで有効(設定不要) */- ✓ドメインシャーディングは不要:HTTP/1.1では接続数を増やすためにリソースを複数ドメインに分散させていましたが、HTTP/2では逆効果です。1つのドメインにまとめましょう。

- ✓ファイル結合の削減:CSSやJSを1つの巨大ファイルに結合する必要性が低下します。個別ファイルのままでもHTTP/2の多重化で効率的に転送できます。

- ✓スプライトシートの見直し:小さな画像を1枚にまとめるCSSスプライトは、HTTP/2では個別画像の方がキャッシュ効率が良くなる場合があります。

- ✓インライン化の削減:小さなCSS/JSをHTMLにインライン化する手法も、HTTP/2では個別ファイルの方がキャッシュを活用できます。

関連コンテンツ

HTTP通信

ブラウザとサーバー間のHTTPリクエスト/レスポンスの仕組みを可視化

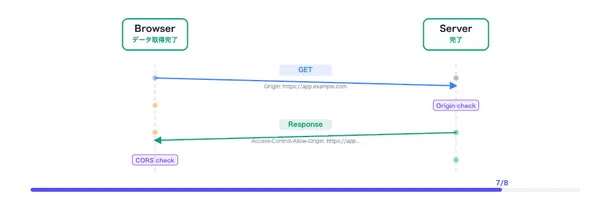

CORS

ブラウザのクロスオリジン制約とCORSヘッダーによるアクセス制御の仕組みを可視化

MQTT(Pub/Subモデル)

MQTTブローカーを経由したPublish/Subscribeモデルの通信フローを可視化します

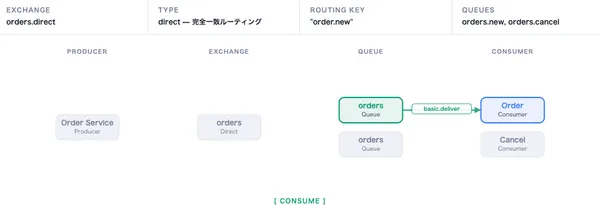

AMQP(メッセージキュー)

RabbitMQなどで使われるAMQPのExchange・Queue・Bindingの仕組みを可視化します

WebSocket

HTTPハンドシェイクから始まる双方向リアルタイム通信プロトコルの仕組みを可視化

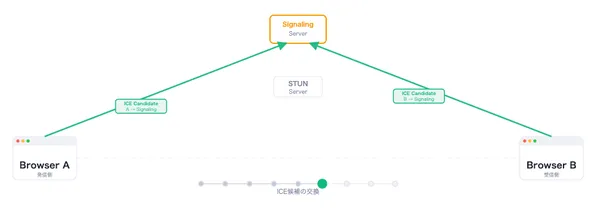

WebRTC(Web Real-Time Communication)

ブラウザ間のP2P通信。ビデオ通話・画面共有・ファイル転送に使われるリアルタイム通信技術